Inteligencia híbrida: cuando la educación se escribe entre humanos y máquinas

Un marco filosófico y pedagógico para diseñar ecosistemas de aprendizaje aumentados por inteligencia artificial

“La prioridad debe ser preservar la agencia humana en un mundo cada vez más automatizado.”

UNESCO, Día Internacional de la Educación 2025

Un nuevo escenario educativo

La inteligencia artificial ya dejó de ser un recurso marginal: hoy atraviesa la enseñanza, desde la planificación de clases hasta la evaluación de tareas. ChatGPT, Gemini o Copilot han convertido lo que parecía un futuro lejano en un presente ineludible. Pero la pregunta no es si debemos usarlos, sino cómo convivir con estas herramientas sin perder lo esencialmente humano de la educación.

Aquí entra en juego un concepto cada vez más citado: la inteligencia híbrida, entendida como la sinergia entre capacidades humanas y artificiales. No se trata de reemplazo ni de competencia, sino de imaginar la educación como un espacio de co-inteligencia, donde las personas y las máquinas aprenden juntas.

Más que herramientas: aliados de pensamiento

La UNESCO ha insistido en que la IA en la educación debe tener un enfoque humanista: “preservar la agencia humana en un mundo de automatización”. Dicho de otra forma: las máquinas pueden procesar datos a velocidades inimaginables, pero solo los seres humanos aportamos propósito, ética, empatía y creatividad.

El filósofo Ilkka Tuomi lo sintetiza con claridad: si la información está a un clic, la tarea de la escuela ya no es llenar cabezas de datos, sino ayudar a los estudiantes a tener voz propia, a discernir, a decidir y a actuar con responsabilidad.

El valor de la co-inteligencia

El académico Ethan Mollick habla de “co-inteligencia” para describir la práctica cotidiana de trabajar junto a la IA: invitarla a participar en nuestras tareas, pero siempre desde un rol de guía humano. En sus palabras: “sé la aportación humana en el circuito”.

Este enfoque implica ver a la IA como un catalizador y no como un sustituto: un socio que amplía nuestras capacidades sin erosionar aquello que nos hace únicos. La filosofía de la inteligencia híbrida no busca que las máquinas piensen por nosotros, sino que piensen con nosotros.

¿Cómo se ve esto en el aula?

La inteligencia híbrida ya no es solo teoría: existen modelos educativos y experiencias piloto que muestran cómo se traduce esta colaboración en prácticas concretas.

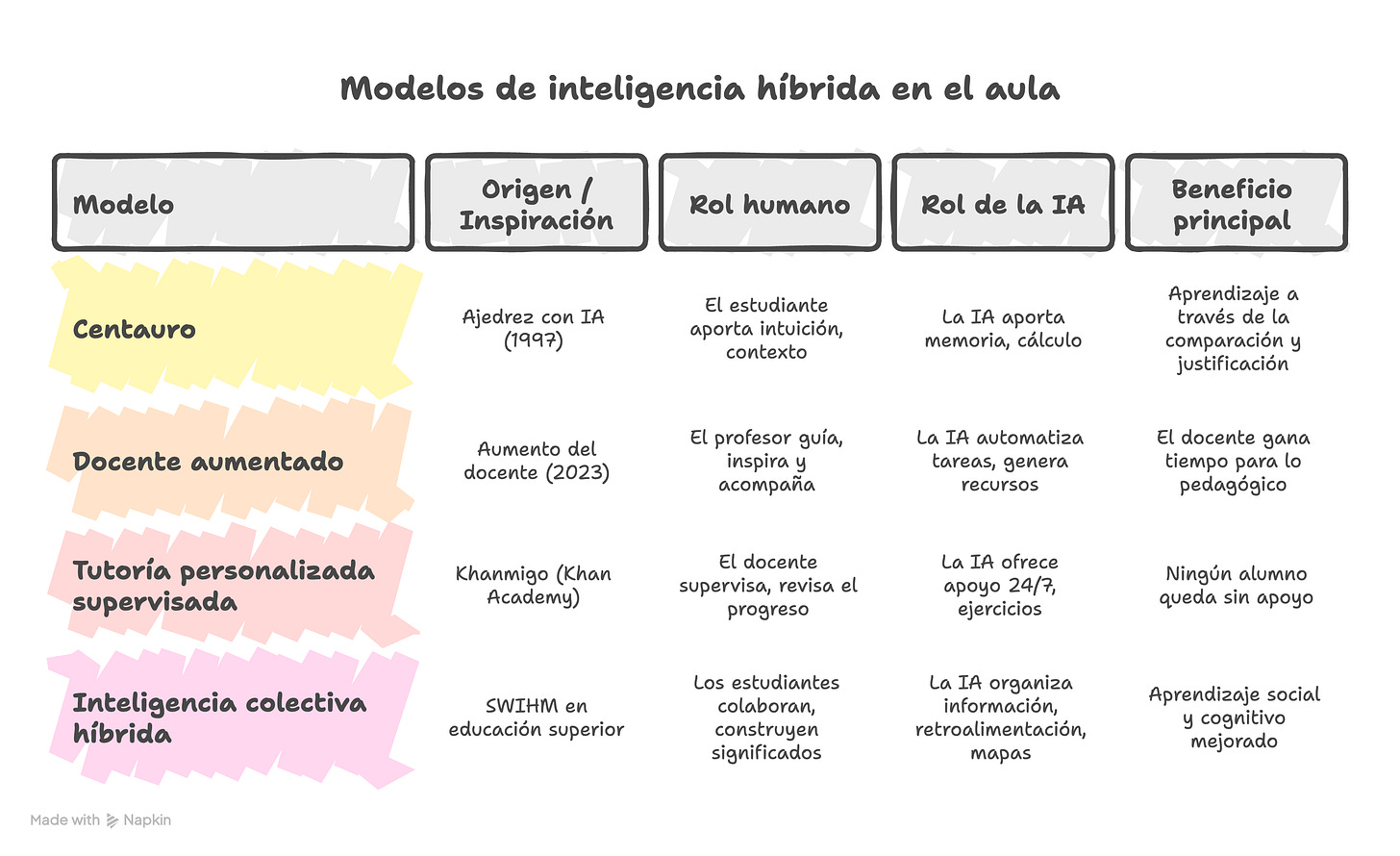

El modelo centauro

Su origen está en el ajedrez. Tras la derrota de Garry Kasparov frente a Deep Blue (1997), algunos jugadores comenzaron a competir en formato “centauro”: un humano apoyado por un motor de IA. El resultado fue sorprendente: los equipos híbridos vencían incluso a las mejores máquinas en solitario. Trasladado a la educación, el modelo propone parejas estudiante–IA trabajando juntos en resolución de problemas. El estudiante aporta intuición, creatividad y comprensión del contexto; la IA suma velocidad de cálculo, memoria y generación de alternativas. El aprendizaje ocurre precisamente en la comparación, crítica y selección de las propuestas de la IA. En la práctica: alumnos usando ChatGPT o Gemini para explorar múltiples soluciones matemáticas, pero justificando en clase por qué una respuesta es válida y otra no.

El docente aumentado

Este enfoque parte de la idea de teacher augmentation: no se trata de sustituir al profesor, sino de ampliar su capacidad profesional. Australia, en su Framework for Generative AI in Schools (2023), señala que la IA puede reducir carga administrativa y liberar tiempo docente. Por ejemplo:

Corrección automática de tareas de opción múltiple.

Generación de informes de progreso para cada estudiante.

Creación de materiales adaptados (lecturas simplificadas, ejemplos adicionales).

El valor no es la eficiencia en sí misma, sino permitir que el docente concentre su energía en lo pedagógico y lo humano: motivar, acompañar, inspirar. En palabras de la UNESCO, “los docentes deben seguir siendo insustituibles en su rol de guías y mediadores” .

Tutoría personalizada supervisada

Aquí entran los asistentes de aprendizaje 24/7, que acompañan a los estudiantes fuera del aula. Un ejemplo es Khanmigo (Khan Academy), un tutor conversacional que responde dudas, explica conceptos paso a paso y sugiere ejercicios. Lo novedoso es que el docente supervisa estas interacciones a través de paneles de progreso, manteniendo control pedagógico. Este modelo busca que ningún alumno se quede sin apoyo, especialmente fuera del horario escolar, pero reconoce un riesgo: la sobredependencia. Por eso, se recomienda que el tutor de IA no entregue la respuesta de inmediato, sino que guíe con pistas graduales. La OCDE subraya que este enfoque debe preservar la agencia del estudiante, evitando que se convierta en un receptor pasivo .

Inteligencia colectiva híbrida

Más allá de la interacción uno a uno, surgen plataformas que integran inteligencia individual, colectiva y artificial. Un ejemplo es el Sistema Web de Inteligencia Híbrida Multimodal (SWIHM), desarrollado en educación superior. La lógica es constructivista: los estudiantes trabajan en equipo, apoyados por IA que organiza información, ofrece retroalimentación inmediata o estructura debates. Lo central es que la IA facilita la interacción social y cognitiva, pero los significados se construyen entre personas. Este enfoque enfatiza la dimensión comunitaria del aprendizaje: la IA no reemplaza la conversación humana, sino que la amplifica (ej. organizando mapas conceptuales de los aportes del grupo en tiempo real).

Lo común en todos estos casos es que la IA no sustituye el proceso humano, sino que lo expande y redistribuye: el estudiante gana autonomía, el docente gana tiempo y la comunidad gana nuevas formas de colaboración.

Filosofía práctica: repensar qué significa aprender

El debate es más profundo que la simple utilidad. Supone preguntarnos:

¿Qué significa aprender en un contexto donde la IA responde de inmediato?

¿Qué habilidades deben priorizarse cuando la memorización ya no es la medida del saber?

¿Qué riesgos asumimos si delegamos demasiado a las máquinas?

Hans Jonas, con su principio de responsabilidad, ya advertía la necesidad de pensar en las consecuencias a largo plazo de nuestras decisiones tecnológicas. En educación, esto significa diseñar la colaboración humano–IA con la mirada puesta en las futuras generaciones: qué tipo de inteligencias queremos cultivar.

Riesgos que no podemos ignorar

La inteligencia híbrida no es un camino libre de obstáculos. Entre los principales riesgos destacan:

Pereza cognitiva: estudiantes que dejan de esforzarse y dependen de la IA.

Erosión de la agencia: docentes y alumnos adaptándose “al algoritmo” y perdiendo autonomía.

Sesgos y alucinaciones: máquinas que producen errores o reproducen discriminaciones.

Privacidad en riesgo: sistemas que almacenan datos sensibles sin garantías suficientes.

Desigualdad de acceso: escuelas con recursos que avanzan, mientras otras se quedan atrás.

Deshumanización: olvidar que ninguna IA puede sustituir la empatía y la presencia de un buen maestro.

Como advierte Wayne Holmes, no podemos caer en el espejismo de creer que la IA es más inteligente de lo que es: lo crucial es que todos aprendamos a usarla con pensamiento crítico.

Lecciones de organismos internacionales

Distintos países e instituciones ya están trazando caminos:

UNESCO: promueve un uso humanista, centrado en la agencia y la equidad.

OCDE: pide replantear currículos y evaluaciones, priorizando lo que complementa a las máquinas.

Australia: lanzó un marco nacional para el uso seguro y ético de IA generativa en escuelas.

Canadá: reclama regulaciones urgentes para proteger la privacidad estudiantil.

Finlandia: integra la IA en la educación como oportunidad para fortalecer la agencia y la voz propia de los alumnos.

Estos ejemplos muestran que la inteligencia híbrida requiere visión de política pública y no puede quedar solo en manos del mercado tecnológico. Dejar en manos de las grandes corporaciones el rumbo de esta transformación significaría aceptar que sean sus intereses comerciales —y no las necesidades pedagógicas, éticas o sociales— los que definan cómo aprendemos. La educación, como bien público, necesita marcos de gobernanza que garanticen que la IA se utilice para ampliar la equidad y la agencia humana, y no únicamente para consolidar posiciones de poder de unas pocas empresas.

Hacia ecosistemas de aprendizaje humanamente aumentados

El futuro de la educación no se juega en los extremos. Ni en prohibir la IA —una medida poco realista y que solo profundizaría brechas—, ni en rendirse ciegamente al entusiasmo tecnológico, adoptando cada novedad sin medir consecuencias. La verdadera alternativa está en construir ecosistemas de aprendizaje híbridos, donde la inteligencia humana permanezca en el centro, potenciada pero nunca sustituida por la inteligencia artificial.

Un ecosistema de este tipo no es solo un aula con dispositivos, ni una plataforma en línea con algoritmos. Implica una red integrada de personas, tecnologías, políticas y valores que se articulan para sostener un aprendizaje inclusivo, crítico y transformador.

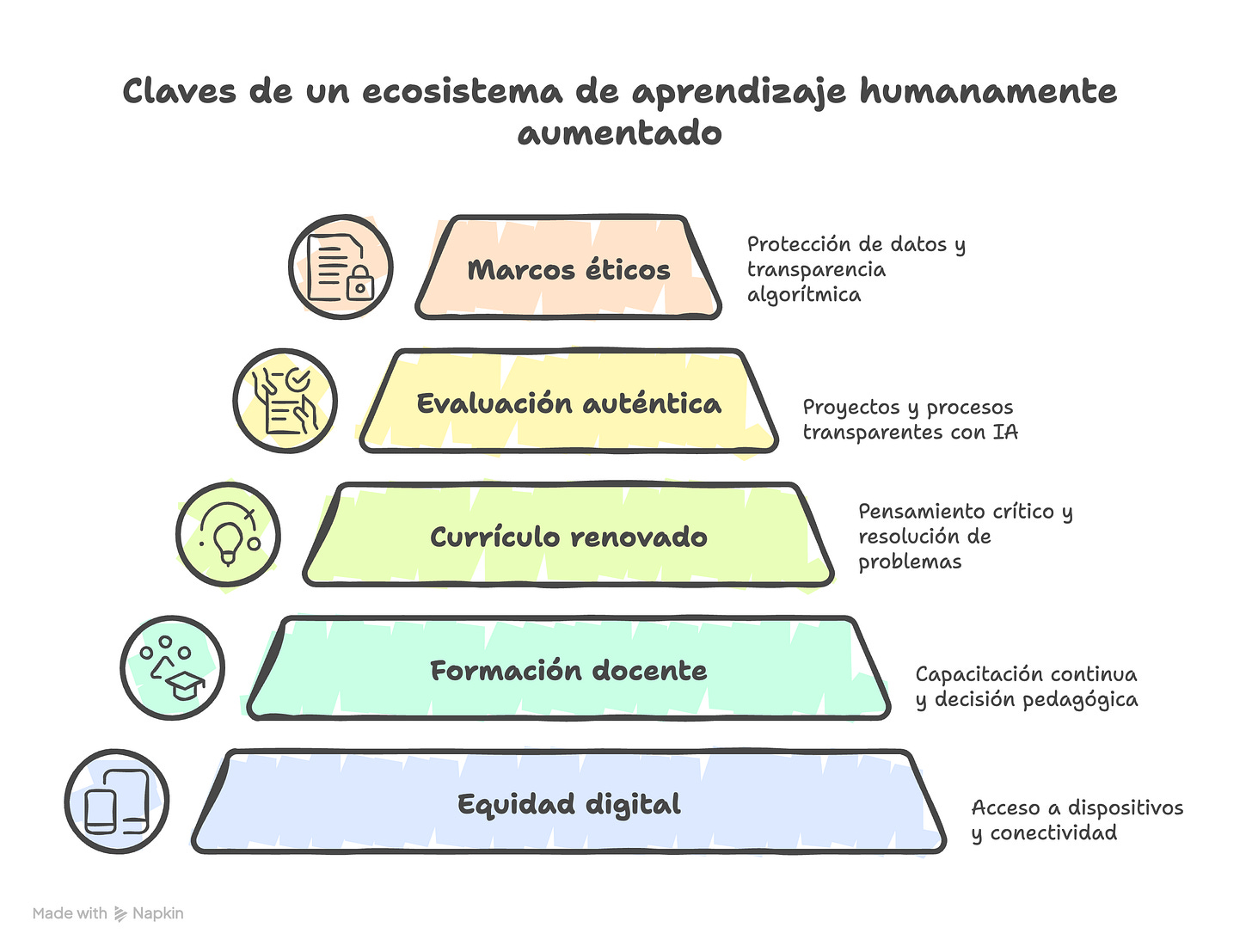

Algunas claves para avanzar hacia esa visión:

Empoderar a los docentes con formación y autonomía

La experiencia internacional muestra que los profesores suelen ser los primeros en enfrentarse a la IA sin preparación suficiente. Necesitan programas de capacitación continua, no solo en lo técnico (cómo usar una herramienta), sino en lo pedagógico y ético: cómo diseñar actividades con IA sin perder la autoría del estudiante, cómo enseñar a verificar la información generada, cómo acompañar procesos híbridos. Además, deben tener autonomía profesional para decidir cuándo y cómo integrar la IA, evitando imposiciones de plataformas o políticas que reduzcan su rol a simples facilitadores.

Diseñar currículos que prioricen pensamiento crítico, creatividad y ética

Si la IA resuelve tareas rutinarias, el currículo debe moverse hacia lo que las máquinas no hacen bien: formular buenas preguntas, deliberar sobre dilemas éticos, crear narrativas propias, trabajar en equipo, innovar en contextos inciertos. La OCDE ya advirtió que la IA obliga a repensar qué y cómo enseñamos, priorizando competencias humanas que complementen a la tecnología. Esto exige revisar contenidos, métodos y, sobre todo, sistemas de evaluación, que deben medir no solo qué produce el estudiante, sino cómo lo hace en interacción con la IA.

Establecer marcos regulatorios claros y participativos

La educación no puede quedar a merced de los intereses del mercado tecnológico. Sin regulación, serán las grandes corporaciones quienes definan qué herramientas entran al aula, con qué datos se entrenan y qué valores transmiten. Necesitamos políticas públicas que establezcan límites y estándares: protección de datos estudiantiles, transparencia algorítmica, prohibición de usos intrusivos como la vigilancia biométrica. Estos marcos deben construirse con participación de docentes, estudiantes y familias, para que reflejen necesidades pedagógicas y no solo criterios comerciales.

Invertir en equidad digital para no dejar a nadie atrás

La promesa de la inteligencia híbrida solo será real si se garantiza que todas las escuelas y comunidades tengan acceso a conectividad, dispositivos y formación en IA. De lo contrario, se ampliarán aún más las brechas educativas y sociales. La UNESCO ha insistido en que la IA debe contribuir a “educación para todos”, no solo para quienes pueden pagar suscripciones premium. La equidad digital incluye también contenidos en diversos idiomas y herramientas accesibles para estudiantes con discapacidad.

Evaluar con rigor los impactos sin caer en la fascinación tecnológica

Demasiadas veces la innovación educativa se ha adoptado bajo promesas de modernización sin evidencia real de su impacto. Con la IA, la urgencia de evaluar es aún mayor. Se necesitan investigaciones independientes y observatorios de impacto que midan: ¿qué aprendizajes se fortalecen con IA?, ¿qué habilidades se debilitan?, ¿cómo afecta a la motivación y a la autonomía?, ¿qué sesgos reproduce? Evitar la fascinación tecnológica implica aceptar que no todo lo nuevo es mejor, y que a veces la mejor innovación es frenar, reflexionar y ajustar.

En síntesis, los ecosistemas de aprendizaje humanamente aumentados deben ser espacios donde la IA amplíe la capacidad humana, pero no la suplante; donde las máquinas se usen para liberar tiempo, democratizar acceso y estimular creatividad, pero nunca para reemplazar el juicio, la empatía o la voz de quienes aprenden y enseñan.

Una invitación a pensar con valentía

La inteligencia híbrida es, sobre todo, una invitación a repensar qué significa educar en la era de la IA. No es cuestión de si la máquina puede hacerlo, sino de si debe hacerlo, y en qué condiciones.

Como dice Tuomi: “la función central de la educación es ayudarnos a ser personas con voz propia”. Ese debe ser el norte.

Si lo logramos, la IA no será un sustituto, sino un compañero de viaje que amplía nuestra capacidad de aprender, enseñar y transformar el mundo.